纠正图像生成器模型中的偏差

图像生成器模型(基于文本描述生成新图像的系统)在过去一年中已成为一种常见且众所周知的现象。它们不断改进,很大程度上依赖于人工智能领域的发展,使其成为各个领域的重要资源。

为了取得良好的结果,这些模型需要经过大量的图文对训练,例如,将“狗的图片”文本与狗的图片进行匹配,重复数百万次。通过这种训练,模型学会生成狗的原始图像。

然而,正如亨利和玛丽莲陶布计算机科学学院的博士生哈达斯奥加德(HadasOrgad)和同一学院的毕业生巴哈特卡瓦尔(BahjatKawar)所指出的那样,“由于这些模型是在大量来自现实世界的数据上进行训练的,因此它们在训练过程中获得并内化了对世界的假设。

“其中一些假设很有用,例如‘天空是蓝色的’,它们让我们即使使用简短的描述也能获得美丽的图像。另一方面,该模型还编码了关于世界的错误或不相关的假设,以及社会偏见。例如,如果我们要求StableDiffusion(一种非常流行的图像生成器)提供一张CEO的照片,我们只会在4%的情况下得到女性的照片。”

这些模型面临的另一个问题是,我们周围的世界发生了大量变化。训练过程之后,模型无法适应这些变化。

正如陶布计算机科学学院博士生达娜·阿拉德(DanaArad)所解释的那样,“在训练过程中,模型还学习了很多关于世界的事实知识。例如,模型了解国家元首、总统的身份,甚至是电视剧中扮演热门角色的演员的身份。”

“此类模型在训练过程结束后不再更新,因此如果我们今天要求模型生成美国总统的照片,我们仍然可能会收到唐纳德·特朗普的照片,当然,他近年来并没有担任总统。我们希望开发一种有效的方法来更新信息,而不依赖于昂贵的行动。”

这些问题的“传统”解决方案是用户不断修正数据、重新训练或微调。然而,这些修复在财务、工作量、结果质量和环境方面(由于计算机服务器运行时间较长)都会产生高昂的成本。此外,实施这些方法并不能保证控制不必要的假设或可能出现的新假设。“因此,”他们解释说,“我们希望有一种精确的方法来控制模型编码的假设。”

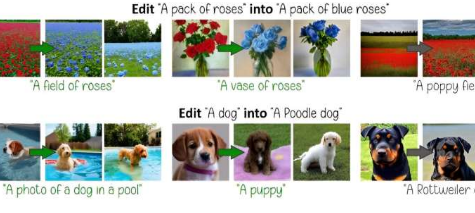

在YonatanBelinkov博士的指导下,博士生开发的方法解决了这一需求。第一种方法由Orgad和Kawar开发,称为TIME(文本到图像模型编辑),可以快速有效地纠正偏见和假设。

原因在于,修正过程不需要微调、重新训练或更改语言模型和文本解释工具,而只需对模型约1.95%的参数进行部分重新编辑。而且,同样的编辑过程只需不到一秒的时间。

免责声明:本文由用户上传,与本网站立场无关。财经信息仅供读者参考,并不构成投资建议。投资者据此操作,风险自担。 如有侵权请联系删除!

-

【木地板材料】木地板是一种广泛应用于家居和商业空间的地面装饰材料,因其自然美观、耐用性强、环保性好等特...浏览全文>>

-

【木地板安装】木地板安装是一项需要细致规划和专业操作的工程,无论是新房装修还是旧房翻新,选择合适的木地...浏览全文>>

-

【木的组词怎么写】在汉语学习中,词语的积累和运用是非常重要的部分。对于“木”这个字来说,它不仅是常见的...浏览全文>>

-

【木的象形字有哪些字】在汉字的发展过程中,许多字最初都是通过象形的方式创造出来的,用来表示具体的事物。...浏览全文>>

-

【木岛法子介绍】木岛法子(Kazuko Kikuchi)是日本著名演员、模特及艺人,以其在影视作品中的出色表现和独特...浏览全文>>

-

【木代尔是什么面料】“木代尔是什么面料”是许多消费者在选购衣物时常常会提出的问题。木代尔是一种天然纤维...浏览全文>>

-

【木代尔和莫代尔哪种面料好】在选择衣物面料时,很多人会遇到“木代尔”和“莫代尔”这两个名称,容易混淆它...浏览全文>>

-

【萝卜的营养价值】萝卜是一种常见的根茎类蔬菜,不仅味道清脆爽口,还具有丰富的营养价值。无论是生吃、炒食...浏览全文>>

-

【萝卜的药用功效和作用】萝卜,作为日常生活中常见的蔬菜之一,不仅味道清脆、营养丰富,还具有多种药用价值...浏览全文>>

-

【萝卜的家常做法】萝卜是一种非常常见的蔬菜,不仅价格实惠,而且营养丰富,适合多种烹饪方式。无论是炖、炒...浏览全文>>