在Apple刚刚发布的一份新闻稿中,刚刚宣布了一些明确为iPadOS17和iOS17设计的重大新辅助功能。新的辅助功能旨在让每个人的生活和使用Apple设备更轻松,将于今年晚些时候推出。

对于那些有认知障碍的人来说,有一些新功能,包括辅助访问、实时语音和个人语音高级语音辅助功能,让用户可以输入他们想说的话,而放大镜中的指向和说话模式可以让盲人用户指向和说话,或者视力低下的人。

不确定这意味着什么?我们会给你详细信息。

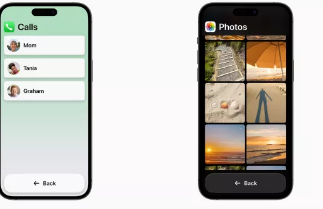

iOS17和iPadOS17中明显出现的第一个新功能是辅助访问,它将应用程序和体验集中或“提炼”为“它们的基本功能,以减轻认知负担”。它们使iPad和iPhone上一些最流行的功能,例如听音乐、与亲人联系以及欣赏照片,让更多人更容易使用。

它将具有“电话和FaceTime的定制体验,现在已合并到通话应用程序中”。有一个简单而独特的用户界面,带有高对比度按钮和更大的文本标签,以及更直观的设备使用方式。例如,现在有一个只有表情符号的键盘。

您也可以将第三方应用程序添加到此作为“快捷方式”。因此,如果您经常使用YouTube,则可以轻松地将其添加到此网格中。通话还合并了“电话”和“FaceTime”,这是有道理的,因此您可以在您的联系人中找到朋友或家人,并决定是否要通过音频或视频给他们打电话。

LiveSpeechandPersonalVoiceAdvanceSpeechAccessibility“旨在支持全球数百万无法说话或随着时间的推移失去言语能力的人。”它会让用户输入他们想说的话,然后它会用用户创建的个性化语音进行播放。这是来自一个简短的设置,它看到用户“阅读随机文本提示集,以在iPhone或iPad上录制15分钟的音频。”这使用深度学习来创建听起来像读者的声音。

这些将在今年晚些时候适用于iPhone12及更高版本。

放大镜中的检测模式将告诉有视力障碍的人说了什么,什么是什么。例如,将它指向外面的标志,它会为您读出该标志。当你看着烤箱或微波炉之类的东西并指向一些文本时,它会检测到你指向的位置,并为你读出文本的内容。它可以与Magnifier中的更多辅助功能相结合,“例如人员检测、门检测和图像描述,以帮助用户浏览他们的物理环境。”

由于它使用iPhone12Pro及更高版本中的LiDAR扫描仪,因此这些iPhone和配备扫描仪的iPadPro型号也可以使用此功能。

虽然Apple没有直接表示这些适用于iOS17和iPadOS17,但去年它在WWDC2022之前预览了新的辅助功能时也发生了同样的情况。

这些都使iOS和iPadOS对用户的帮助比以往任何时候都大,真正与Apple最好的iPhone和最好的iPad一起成为不仅仅是智能手机和平板电脑,而且还是有用的辅助工具。Apple并没有确切说明新功能的发布时间,只是在“今年晚些时候”确认了这些功能。